【技术揭秘】从光子到数据,揭秘摄像头背后的视觉智能

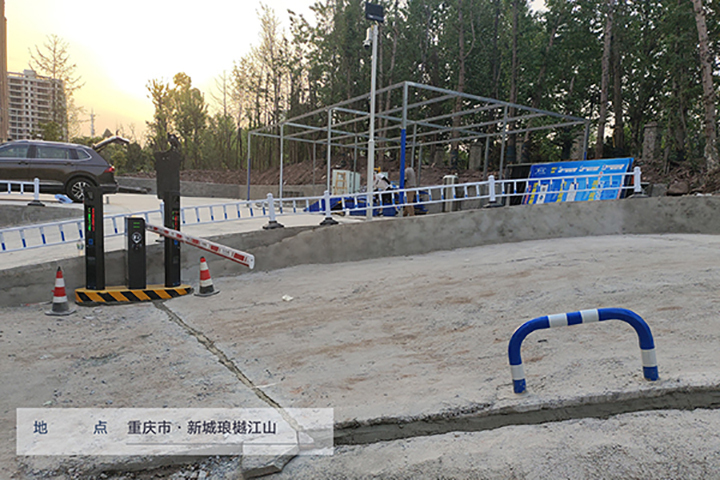

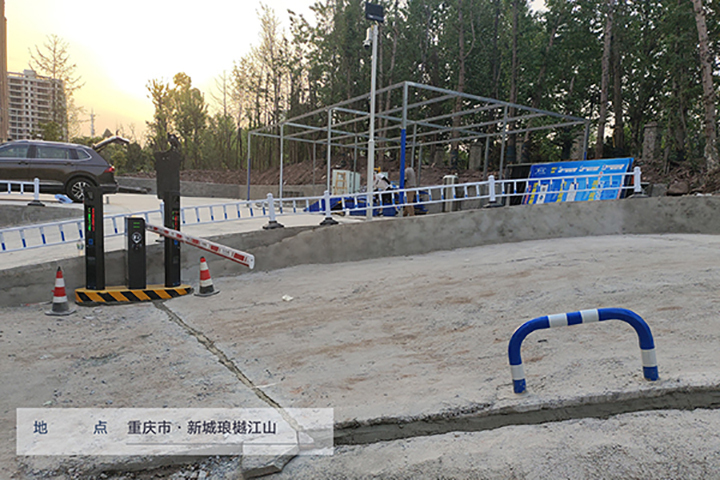

每天,数百万车辆进出停车场、高速收费站、城市卡口,车牌识别系统在0.3秒内完成"看牌-认字-决策"的全流程。这套系统的"眼睛"——摄像机,究竟如何做到比人眼更快更准地读取车牌?让我们沿着光的路径,揭开机器视觉的奥秘。

第一关:捕光捉影,把世界变成数字

一切始于光子。车牌反射的光线穿过防护玻璃,进入摄像机的镜头组。这里的光学设计大有讲究:大光圈保证低照度下的进光量,多层镀膜抑制眩光与鬼影,自动变焦机构根据场景调整焦距。

光线最终抵达图像传感器——通常是CMOS芯片,数以千万计的光敏像素整齐排列。每个像素将光信号转换为电信号,再经模数转换变成数字图像。这一步的精度决定了后续识别的天花板:200万像素是入门,400万已成主流,800万则用于超宽车道或复杂场景。

但raw数据只是起点。图像信号处理器(ISP)立即接手,完成降噪、白平衡、宽动态、锐化等一系列"修图"操作。尤其在车牌识别场景中,强光抑制与背光补偿至关重要——正午阳光直射或夜间车灯照射时,ISP必须平衡明暗,确保车牌区域既不过曝也不欠曝。

第二关:火眼金睛,在画面中锁定目标

图像已清晰,但画面里还有天空、树木、车身、行人——如何找到车牌?这靠目标检测算法。

传统方法依赖人工设计的特征:车牌的矩形轮廓、蓝底白字或绿底黑字的色彩特征、字符的纹理规律。工程师编写规则,让程序在图像中"按图索骥"。

如今,深度学习彻底改变了这一环节。卷积神经网络(CNN)经过数万张标注图像的训练,学会了自动提取特征。它不再告诉程序"车牌是蓝色的矩形",而是让机器自己发现:边缘的梯度变化、色彩的统计分布、纹理的重复模式。检测精度从90%跃升至99%以上,且能应对倾斜、遮挡、污损等复杂情况。

检测模型输出车牌的边界框坐标,告诉后续模块:"目标在此,请聚焦处理。"

第三关:抽丝剥茧,把车牌变成字符

锁定车牌区域后,需要将其从背景中分离,并切割成单个字符。这步称为图像预处理与字符分割。

预处理包括几何校正——利用透视变换将倾斜的车牌"拉正";尺寸归一化——调整为标准比例便于后续识别;二值化——在灰度图像中分离字符与背景。对于新能源绿牌,还需特殊的色彩空间转换,增强绿色背景与字符的对比度。

字符分割曾是最易出错的环节。传统方法基于投影分析:统计每列像素的黑白分布,找到字符间隙。但粘连、断裂、边框干扰常导致误判。现代端到端识别网络已绕过显式分割,直接输入车牌图像,输出完整字符序列,错误率大幅降低。

第四关:认字识数,从像素到文本

现在,系统面对的是一个个字符图像——可能是"京"、可能是"A"、可能是"5"。如何确定它是谁?

这靠光学字符识别(OCR)模型。基于深度学习的识别网络,如CRNN(卷积循环神经网络)或Transformer架构,将字符图像编码为特征向量,再解码为概率分布。模型输出每个位置最可能的字符,以及置信度分数。

针对车牌的特殊性,模型还融入先验知识:第一位只能是汉字(省份简称),第二位只能是字母(城市代码),后几位遵循特定编排规则。这些约束通过语言模型或结构化损失函数嵌入,大幅提升识别准确率。

最终,系统输出一串文本:"渝A·12345",并附带置信度。若分数超过阈值,直接放行;若低于阈值,标记为异常待人工复核。

第五关:智慧大脑,从识别到决策

识别结果并非终点。系统还需查询数据库:这是月租车辆吗?余额是否充足?有无黑名单记录?同时,触发关联动作:抬杆放行、计费累加、日志记录、推送通知。

这一切在边缘计算节点完成——摄像机内置的AI芯片或车道旁的智能盒子。本地化部署将响应时间压缩至毫秒级,即使网络中断也能离线运行。识别结果同步上传云端,用于数据分析与远程监管。

超越人眼:机器视觉的独特优势

车牌识别系统的"眼睛",在某些维度已超越人类:

速度:从图像采集到结果输出,全程0.3秒,人眼刚完成一次扫视;耐力:7×24小时不间断工作,不受疲劳、情绪、分心影响;记忆:instantly调取数百万条记录,人脑无法比拟;光谱:红外补光下清晰成像,人眼在黑暗中近乎失明。

但机器也有局限:它不懂"这是老张的车",不会说"欢迎回家",无法在系统故障时灵活变通。人机协同,才是智慧停车的完整图景。

结语:看见与被看见

当车辆驶过道闸,很少有人抬头看那台摄像机。它静默地悬挂着,每秒处理数十帧图像,将光子的舞蹈转化为比特的流动,最终变成抬杆的动作、计费的数据、管理的决策。

这双"眼睛"的背后,是光学、算法、工程学的精密协作,是无数工程师对"更快、更准、更稳"的执着追求。它让我们得以从重复劳动中解放,去关注更有价值的创造与服务。

科技之眼,最终是为了让人被更好地看见。

产品咨询

产品咨询